Философия искусственного интеллекта | это… Что такое Философия искусственного интеллекта?

Философия искусственного интеллекта задаётся вопросами о «мышлении машин», рассматривает вопросы:

- Может ли машина действовать разумно? Может ли она решать проблемы, которые человек решает с помощью размышлений?

- Может ли машина иметь разум, сознание, психическое состояние в той мере, в которой ими обладает человек. Может ли она чувствовать?

- Одинакова ли природа человеческого и искусственного интеллекта? Является ли в своей основе человеческий мозг компьютером?

Эти вопросы отражают интересы различных исследователей искусственного интеллекта, философов, исследователей познавательной (когнитивной) деятельности. Ответы на эти вопросы зависят от того, что понимается под понятиями «интеллект» или «сознания», и какие именно «машины» являются предметом обсуждения.

Содержание

|

Может ли машина мыслить?

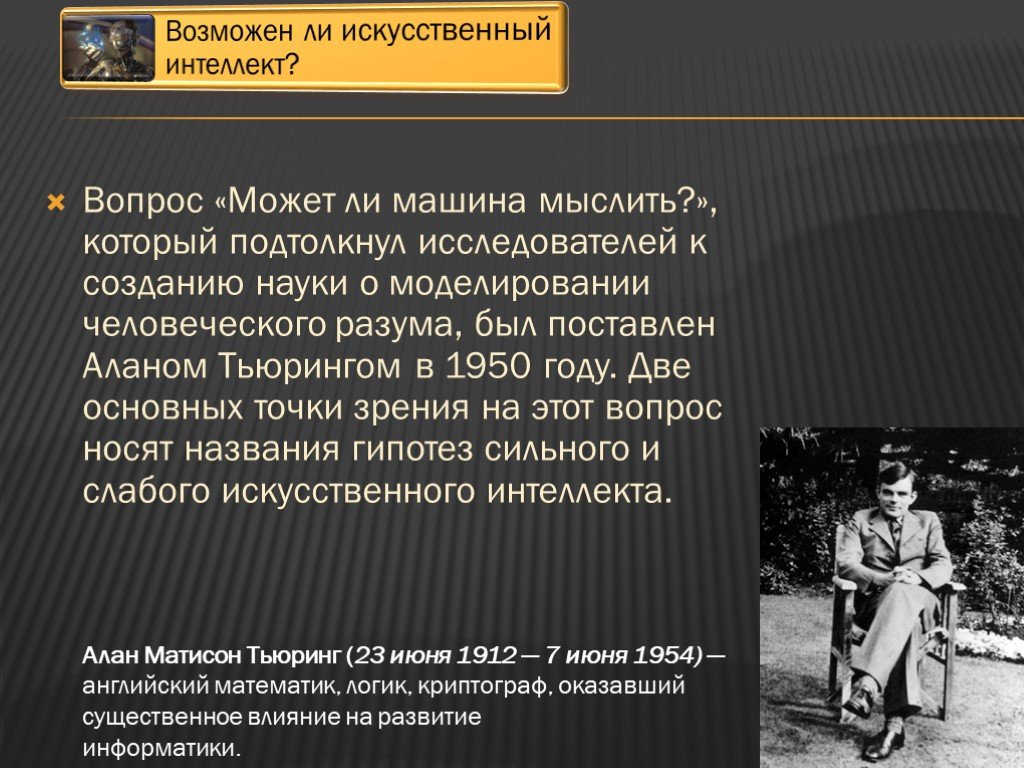

Наиболее горячие споры в философии искусственного интеллекта вызывает вопрос возможности мышления творения человеческих рук. Вопрос «Может ли машина мыслить?», который подтолкнул исследователей к созданию науки о моделировании человеческого разума, был поставлен Аланом Тьюрингом в 1950 году. Две основных точки зрения на этот вопрос носят названия гипотез сильного и слабого искусственного интеллекта.

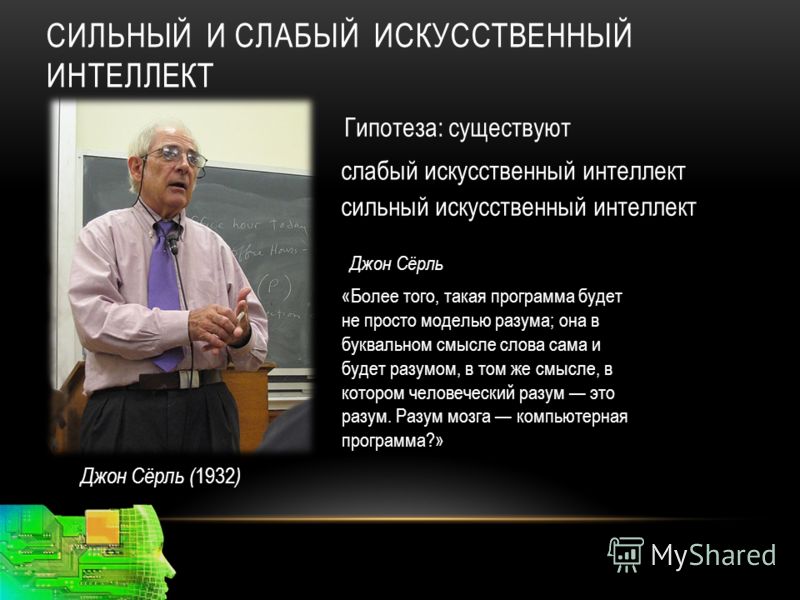

Термин «сильный искусственный интеллект» ввел Джон Сёрль, его же словами подход и характеризуется:

Более того, такая программа будет не просто моделью разума; она в буквальном смысле слова сама и будет разумом, в том же смысле, в котором человеческий разум — это разум.[1]

Напротив, сторонники слабого ИИ предпочитают рассматривать программы лишь как инструмент, позволяющий решать те или иные задачи, которые не требуют полного спектра человеческих познавательных способностей.

В своем мысленном эксперименте «Китайская комната», Джон Сёрль показывает, что даже прохождение теста Тьюринга может не являться достаточным критерием наличия у машины подлинного процесса мышления.

Мышление есть процесс обработки находящейся в памяти информации: анализ, синтез и самопрограммирование.[источник не указан 861 день]

Аналогичную позицию занимает и Роджер Пенроуз, который в своей книге «Новый ум короля» аргументирует невозможность получения процесса мышления на основе формальных систем[2].

Что считать интеллектом?

Существуют разные точки зрения на этот вопрос. Аналитический подход предполагает анализ высшей нервной деятельности человека до низшего, неделимого уровня (функция высшей нервной деятельности, элементарная реакция на внешние раздражители (стимулы), раздражение синапсов совокупности связанных функцией нейронов) и последующее воспроизведение этих функций. Существует определение интеллекта как способности решать интеллектуальные задачи[источник не указан 639 дней]. Здесь под интеллектуальной задачей понимается та задача, у которой не существует известного алгоритма решения. То есть задача, для которой нужно создать алгоритм с нуля. Например, доказательство недоказанной теоремы, научное открытие, художественная деятельность и так далее. Некоторые специалисты за интеллект принимают способность рационального, мотивированного выбора, в условиях недостатка информации. То есть интеллектуальной просто считается та программа деятельности (не обязательно реализованная на современных ЭВМ), которая сможет выбрать из определенного множества альтернатив, например, куда идти в случае «налево пойдёшь …», «направо пойдёшь …», «прямо пойдёшь …».

Здесь под интеллектуальной задачей понимается та задача, у которой не существует известного алгоритма решения. То есть задача, для которой нужно создать алгоритм с нуля. Например, доказательство недоказанной теоремы, научное открытие, художественная деятельность и так далее. Некоторые специалисты за интеллект принимают способность рационального, мотивированного выбора, в условиях недостатка информации. То есть интеллектуальной просто считается та программа деятельности (не обязательно реализованная на современных ЭВМ), которая сможет выбрать из определенного множества альтернатив, например, куда идти в случае «налево пойдёшь …», «направо пойдёшь …», «прямо пойдёшь …».

Наука о знании

Также, с проблемами искусственного интеллекта тесно связана эпистемология — наука о знании в рамках философии. Философы, занимающиеся данной проблематикой, решают вопросы, схожие с теми, которые решаются инженерами ИИ о том, как лучше представлять и использовать знания и информацию.

Этические проблемы создания искусственного разума

Этот раздел содержит вопросы, касающиеся искусственного интеллекта и этики.

- Если в будущем машины смогут рассуждать, осознавать себя и иметь чувства, то что тогда делает человека человеком, а машину — машиной?

- Если в будущем машины смогут осознавать себя и иметь чувства, возможно ли будет их эксплуатировать или придется наделять их правами?

- Если в будущем машины смогут рассуждать, то как сложатся отношения людей и машин? Данный вопрос был не раз рассмотрен в произведениях искусства на примере противостояния людей и машин. К примеру, батлерианский джихад в романе «Дюна» Фрэнка Герберта, проблемы взаимоотношения с ИскИнами в романе Дэна Симмонса «Гиперион», война с машинами в кинофильме «Терминатор» и так далее.

- Будет ли человек, которому в результате многочисленных медицинских ампутаций заменили 99 процентов тела на искусственные органы, считаться машиной?

Данные вопросы рассматриваются в рамках философии техники и трансгуманистической философии.

См. также

- Теория принятия решений

- Исследование операций

Ссылки

- А. В. Савельев. О конференциях по философии искусственного интеллекта — обзор основных современных направлений философии искусственного интеллекта

Примечания

- ↑ Джон Сёрль. Разум мозга — компьютерная программа?

- ↑ Роджер Пенроуз. Новый ум короля. О компьютерах, мышлении и законах физики. Издательство: УРСС, 2005 г. ISBN 5-354-00993-6

Литература

- Петрунин Ю. Ю., Рязанов М.А., Савельев А. В. Философия искусственного интеллекта в концепциях нейронаук. — 1-е. — М.: МАКС Пресс, 2010. — С. 84. — ISBN 978-5-317-03251-7

Философы — о том, какой искусственный интеллект нам нужен — Нож

Мыслит ли искусственный интеллект?Люди мечтали о роботах еще в античную эпоху, но всерьез начали говорить о создании искусственного интеллекта только в середине прошлого века. Английский математик и логик Алан Тьюринг вынес в заголовок своей статьи «Могут ли машины мыслить?» первый и самый важный вопрос в философии ИИ. А если ответ на него утвердительный, то как это осуществить — и, главное, как мы узнаем о такой суперспособности бездушных механизмов?

А если ответ на него утвердительный, то как это осуществить — и, главное, как мы узнаем о такой суперспособности бездушных механизмов?

Правда, термин «мышление» довольно абстрактный, и множество философов с древнейших времен пыталось определить это понятие — но споры всё еще продолжаются. Потому Тьюринг схитрил и перефразировал свой вопрос: «Сможет ли машина притвориться человеком и тем самым обмануть нас?»

Чтобы это проверить, он предложил тест, своего рода игру в имитацию: участник эксперимента, не видя, кто перед ним, разговаривает либо с компьютером, либо с другим человеком — а затем отвечает, кем был его собеседник.Тест Тьюринга стал стандартом для проверки искусственного интеллекта. Даже сейчас, спустя 70 лет, существует премия Лёбнера: ее получит тот, кто создаст программу, которая пройдет это испытание. В последние несколько лет мы регулярно натыкаемся на сообщения, что очередной чат-бот смог обмануть судей и справился с тестом Тьюринга, но не все исследователи с этим согласны.

Источник

Во-первых, технологии развиваются, а вместе с этим меняется и наше отношение к ним. Потому тест приходится усложнять, чтобы он отвечал современным стандартам.

Например, сам Тьюринг считал, что разговор должен длиться 5 минут, чтобы судьи определили, кто перед ними — машина или человек. Сейчас же полагают, что этого слишком мало, и время эксперимента увеличили до 25 минут.Кроме того, в наши дни компьютером, умеющим просто отвечать человеку, уже никого не удивишь (хотя раньше сама такая способность казалась чудом!). Теперь мы добиваемся, чтобы реплики нашего электронного собеседника были более конкретными. Если мы восторгаемся фильмами Тарантино, то уже не хотим слышать стандартные «Здорово!» или «Ты молодец!» — такие ответы подходят почти к любой теме, и многие чат-боты пользуются этой уловкой, чтобы поддержать разговор (кстати, подобные «скрипты» — один из главных минусов умных программ: они прибегают к ним значительно чаще, чем люди). Сегодня разработчики пытаются добиться от искусственного интеллекта большей «вовлеченности» в беседу — чтобы робот обсудил с нами тонкости сюжета и режиссуры «Однажды в Голливуде» или «Криминального чтива».

Во-вторых, программисты прибегают к различным хитростям, зная, что выносить вердикт будут такие же люди, которые, как и все, подвержены когнитивным искажениям, то есть, проще говоря, ошибаются и не всегда мыслят рационально. Например, компьютерная программа «Евгений Густман», вроде бы успешно прошедшая тест, притворялась 13-летним мальчиком из Украины. Судьям, конечно, приходилось делать скидку на возраст, если Евгений отвечал не совсем точно, поэтому их было легче обмануть.

В-третьих, не все согласны с тем, что тест Тьюринга — лучший инструмент для идентификации мыслящей машины. В конце концов, он всего лишь позволяет определить, получится ли у компьютера обмануть человека и притвориться разумным существом, — но не показывает, удалось ли ему стать таковым.

В качестве иллюстрации последнего пункта американский философ Джон Сёрль предложил мысленный эксперимент, известный как «Китайская комната».Чтобы провести его самостоятельно, вам понадобится вообразить:

— Джона Серля, говорящего на английском, но не знающего китайского языка, — 1 шт.

;

— закрытую комнату — 1 шт.;

— справочник на английском языке, в котором рассказывается, как пользоваться китайскими иероглифами, — 1 шт.;

— носителей китайского языка — 1 шт. и больше.Ход эксперимента

Шаг 1. Поместите в своей голове Джона Серля в воображаемую закрытую комнату вместе со справочником. Пусть он его там изучает.

Шаг 2. Поставьте снаружи человека, владеющего китайским, который напишет вопросы на нем и просунет их через щель в закрытую комнату, не зная, кто там находится и понимает ли он этот язык.

Шаг 3. Заставьте Серля отвечать на полученные вопросы. Это несложно — у него же, в конце концов, есть справочник? Он умный, усидчивый и аккуратный: соотнося полученные иероглифы с инструкциями, наш подопытный, совершенно не понимая чужого для него языка, напишет правильные ответы.

Шаг 4. Когда человек, передавший записку Серлю, прочитает их, спросите его, говорит ли экзаменуемый на китайском, — и, конечно, услышите утвердительный ответ: разумеется, вот ведь, всё черным по белому, иероглиф к иероглифу!

Но вам-то известно, что Серль просто действовал по инструкции и на самом деле даже не знает, чего от него хотел собеседник за дверью и что он ему ответил.

«Китайская комната» Серля показывает ту самую разницу между настоящим пониманием и умелым притворством, которая стирается в случае теста Тьюринга. Для машин не важно, что стоит за данными и что означают используемые ими символы: китайские иероглифы, русская кириллица или пиксели картинки. Они не имеют для роботов того смысла, что вкладывают в них люди, и вряд ли даже самые продвинутые устройства когда-нибудь смогут научиться понимать их так же, как мы. Вот что говорит об этом сам Серль в своей статье «Сознание, мозг и программы»:

«Я понимаю рассказы на английском языке; в меньшей степени я понимаю рассказы по-французски; в еще меньшей степени я понимаю рассказы по-немецки; а по-китайски вообще не понимаю. Что же касается моего автомобиля и моей счетной машинки, то они вообще ничего не понимают; они не по этой части. Мы часто метафорически и аналогически атрибутируем „понимание“ и другие когнитивные предикаты автомобилям, счетным машинам и другим артефактам, но такие атрибуции ничего не доказывают.

<…> Тот смысл, в каком автоматическая дверь „понимает инструкции“ посредством своего фотоэлемента, — это вовсе не тот смысл, в каком я понимаю английский язык. Если имеется в виду, что программированный компьютер Шэнка понимает рассказы в том же метафорическом смысле, в каком понимает дверь, а не в том смысле, в каком я понимаю английский язык, то этот вопрос не стоит и обсуждать».

Такой пессимизм, впрочем, свойствен не только современным исследователям. Французский философ Рене Декарт, живший в XVII столетии, тоже писал:

«Но если бы сделать машины, которые имели бы сходство с нашим телом и подражали бы нашим действиям, насколько это мыслимо, то у нас всё же было бы два верных средства узнать, что это не настоящие люди.

Во-первых, такая машина никогда не могла бы пользоваться словами или другими знаками, сочетая их так, как это делаем мы, чтобы сообщать другим свои мысли. <…> Во-вторых, хотя такая машина многое могла бы сделать так же хорошо и, возможно, лучше, чем мы, в другом она непременно оказалась бы несостоятельной, и обнаружилось бы, что она действует не сознательно, а лишь благодаря расположению своих органов.

Ибо в то время как разум — универсальное орудие, могущее служить при самых разных обстоятельствах, органы машины нуждаются в особом расположении для каждого отдельного действия [выделено автором. — Прим. ред.]. Отсюда немыслимо, чтобы в машине было столько различных расположений, чтобы она могла действовать во всех случаях жизни так, как нас заставляет действовать наш разум».

Современные разработки подтверждают справедливость идей Декарта. Несмотря на то, что мы постоянно читаем, как очередная нейросеть стала делать что-то в сотни раз лучше, чем люди, всё это заслуги узкого искусственного интеллекта (narrow artificial intelligence), то есть созданного для решения одной конкретной задачи. Такой ИИ, в отличие от человеческого разума, не многофункционален. Например, он может в миллиарды раз точнее и быстрее, чем мы, находить корни математических уравнений, но никогда (или по крайней мере до тех пор, пока люди его этому специально не научат) не будет говорить даже самые простые слова.

Словом, искусственный интеллект получает «знания», «умения» и «навыки» не так, как мы. Его способность к обучению ограничена одной конкретной областью (которую выбрали программисты). ИИ не может самостоятельно постичь что-то еще: созданный для движения робот не начнет «вдруг» читать, пока в дело не вмешается обслуживающий его заботливый персонал.

Источник

Мы же, в отличие от искусственного интеллекта, способны учиться чему угодно по своей воле, и многие из нас несколько раз за жизнь меняют профессию. Нам не нужно «сносить все настройки» мозга, готовя его к погружению в новую область, в этом смысле он универсален.

И хотя, безусловно, искусственный интеллект «узкого профиля» очень полезен и его можно и нужно применять во многих сферах жизни, тем не менее не стоит ждать, что еще чуть-чуть — и он станет совсем как мы.

Создать один универсальный многозадачный ИИ слишком трудно, во всяком случае пока. Человеческий разум прогрессировал и продолжает развиваться в непредсказуемом мире: нам постоянно приходится сталкиваться с таким количеством нетривиальных задач, что запрограммировать и прописать их все пока не представляется возможным.Да и нужно ли нам это? Более практичным решением сейчас кажется повышение мощностей узкоспециализированного искусственного интеллекта и создание отдельной программы под каждую конкретную задачу. Так мы можем довести их выполнение до совершенства — или хотя бы до уровня, когда машина делает это лучше, чем люди. Искусственный интеллект стал бы незаменимым помощником во многих профессиях, но для каждой области его приходится создавать отдельно — чем в основном и занимается современный IT-бизнес.

Но мы всё равно мечтаем об общем искусственном интеллекте (general artificial intelligence), и сразу несколько исследовательских институтов в мире ведут разработки в этом направлении. Если у них получится, такой продукт станет нашей копией: он сможет учиться выполнять абсолютно разные задачи и переносить свои знания из одной сферы в другую, будет мыслить критически, а еще кооперироваться с людьми или другими искусственными интеллектами, чтобы достичь своих целей.

Удастся ли нам создать такую технологию, пока неизвестно, но, если это произойдет, наш мир круто изменится.

Суперинтеллект: о чём предупреждает Илон МаскПредставлять, как изменится наш мир, если мы сконструируем общий искусственный интеллект или даже суперинтеллект (superintelligence), который превзойдет нас во всех областях одновременно, — любимое занятие философов, футурологов и всех тех, кому нравится мечтать о будущем. Например, Илон Маск уверен, что ИИ — главная угроза человечеству и нам стоит быть осторожнее в гонке высоких технологий. Почему?

Почему?

Читайте также

Восстание машин отменяется: 8 книг, которые сделают вас технооптимистом

Маск советует почитать вышедшую в 2014 году книгу «Искусственный интеллект. Этапы. Угрозы. Стратегии» Ника Бострома — шведского философа, ныне возглавляющего Институт будущего человечества в Оксфордском университете. Он полагает, что, как только нам удастся создать общий ИИ, тот мгновенно эволюционирует до уровня суперинтеллекта, а значит, станет мыслить лучше и быстрее, чем мы:

«Для нас важно создать искусственный интеллект, у которого хватит ума учиться на своих ошибках. Он будет способен бесконечно совершенствовать себя. Первая версия сможет создать вторую, которая будет лучше, а вторая, будучи умнее оригинала, создаст ещё более продвинутую третью и т. д. В определенных условиях такой процесс самосовершенствования может повторяться до тех пор, пока не будет достигнут интеллектуальный взрыв — момент, когда интеллектуальный уровень системы подскочит за короткое время с относительно скромного уровня до уровня суперинтеллекта».

Конечно, нам сложно представить, как поведет себя этот техноджинн из бутылки, какие цели он перед собой поставит, как отнесется к своим создателям, то есть к нам. Бостром считает вполне вероятным следующий сценарий: суперинтеллект за долю секунды просчитает, что ему выгоднее уничтожить человечество, чем его сохранить (в конце концов, мы действительно совершаем множество ошибок — чего стоит одно только загрязнение планеты), и тогда наш вид будет обречен. Нас не ждет война в духе фильмов о Терминаторе, восстание машин — скорее всего, новые хозяева мира сотрут человечество с лица земли так быстро, что мы даже не успеем этого осознать — не то что предотвратить катастрофу.

Если пессимизм Бострома и Маска ничуть вас не пугает, а апокалиптические сюжеты кажутся неправдоподобными, почитайте американского футуролога и изобретателя Рэймонда Курцвейла. Он оптимист и верит, что искусственный интеллект принесет только благо — например, подарит нам вечную жизнь в виртуальной реальности, а нанороботы, которых мы будем вживлять в собственное тело, помогут победить многие болезни.

Читайте также

Цифровой ад, технологический рай или нечто совершенно иное: какие технологии определяют будущее человечества

Интересно, что Бостром отчасти согласен с ним: он считает, что суперинтеллект как раз то самое последнее изобретение человечества, к которому мы должны прийти. После этого ИИ будет заморачиваться и придумывать лекарства от рака и других смертельных болезней, совершенствовать технологии и даже решать философские задачи, а мы заживем в технократическом раю.

Осталось всего ничего — создать этот суперинтеллект таким, чтобы он захотел на нас работать. Потому Бостром уверен, что философам и тем, кто занимается вопросами этики, уже сегодня нужно думать, как объяснить компьютерам человеческую мораль, привить нашу систему ценностей и научить их не только мыслить, но и чувствовать.

Потому Бостром уверен, что философам и тем, кто занимается вопросами этики, уже сегодня нужно думать, как объяснить компьютерам человеческую мораль, привить нашу систему ценностей и научить их не только мыслить, но и чувствовать.

Философия искусственного интеллекта началась с вопроса, могут ли машины мыслить. Однако сегодня киберфилософов (да и разработчиков) больше интересует, способен ли робот испытывать эмоции и как его этому научить. И хотя мы привыкли думать, что разного рода переживания затрудняют мышление (а если так, то зачем они нужны искусственному интеллекту?), исследования в области нейронаук показали, что дела обстоят несколько иначе.

В 1990-х нейробиолог Антонио Дамасио описал историю пациента Эллиота, у которого обнаружили опухоль в мозгу. Операция прошла успешно, но никто не ожидал, что она даст такой странный побочный эффект: больной перестал испытывать какие-либо эмоции.

Казалось бы, что здесь трагичного? Основная проблема была в том, что Эллиот утратил способность принимать решения. Например, когда его просили назначить время следующего сеанса, он долго и нудно описывал все плюсы и минусы каждого дня и часа для встречи, но так и не смог выбрать ни один из них.

Например, когда его просили назначить время следующего сеанса, он долго и нудно описывал все плюсы и минусы каждого дня и часа для встречи, но так и не смог выбрать ни один из них.Источник

С тех пор ученые всё глубже исследуют связь эмоций с интеллектом и понимают, что одно не существует без другого. Оказалось, что от наших переживаний больше пользы, чем вреда: они нас мотивируют и помогают без долгих размышлений и поиска аргументов за и против принимать решения в ситуациях выбора, что важно для выживания организма. Благодаря эмоциям мы реагируем быстрее и действуем эффективнее.

Поэтому прежде, чем создавать искусственное сознание, нам нужно научить машины чувствовать. Тогда они смогут принимать по-настоящему самостоятельные решения и мыслить по-человечески (или по крайней мере лучше понимать людей).Пока нам до этого далеко. Но мы учим искусственный интеллект распознавать человеческие эмоции, а также их имитировать. Например, вы можете накричать на Сири или сказать ей что-то обидное — и она ответит вам, что оскорблена или расстроена (в интернете даже можно найти инструкцию, как вывести электронную помощницу из себя).

Разработчики современных роботов стремятся к тому, чтобы они не только выглядели, но и вели себя как люди — хотя каждый из нас понимает, что они не мы.

Однако не все исследователи искусственного интеллекта поддерживают такой подход. Есть и те, кто опасается, что отношения с ИИ, который лишь притворяется, что испытывает какие-либо эмоции, могут сбить нас с толку и даже нанести психологическую травму.

Мы и так склонны излишне антропоморфизировать технологии, а если они успешно начнут имитировать эмоции, мы рискуем окончательно запутаться, где правда, а где ложь, — и выстраивать доверительные отношения не только с нейросетями, но и с людьми нам станет намного сложнее.Впрочем, австрийский философ Марк Кокельберг считает, что в будущем мы настолько привыкнем к роботам во всех сферах своей жизни и к тому, что они лишь изображают эмоции, не испытывая их на самом деле, что это вряд ли станет большой проблемой. Скорее, философов должно волновать, как в таком случае обращаться с искусственным интеллектом: он уже не просто безмолвная вещь — но пока ничего не чувствует. Это один из самых острых этических вопросов, над которыми бьются кибермыслители.

Это один из самых острых этических вопросов, над которыми бьются кибермыслители.

Камень можно пнуть, выбросить или положить на стол и любоваться им, а вот с людьми мы уже так не поступаем. Философы, занимающиеся вопросами этики, вводят категорию морального статуса, определяющего права и обязательства, которыми наделяется тот или иной объект, животное, человек.

Благодаря Иммануилу Канту мы верим, что все люди заслуживают одинакового уважения и равных прав и никем нельзя манипулировать, что другой всегда цель, но не средство к ее достижению. Немецкий философ объяснял это тем, что каждый человек способен к мышлению, что автоматически ставит его в один ряд с себе подобными, независимо от социального статуса, цвета кожи, гендерной идентичности и прочих различий.

В ХХ веке представители этической философии заметили, что нам стоит относиться с уважением не только к другим людям, но и к животным, которые заслуживают этого не меньше. Способность испытывать боль и страдания стала основой для теории морального статуса. Чуть позже круг таких объектов расширился (во многом благодаря активной разработке экологических проблем) — в него предложили включить растения и вообще всё живое. Впрочем, это решение пока остается спорным — как и вопрос о моральном статусе искусственного интеллекта.

Способность испытывать боль и страдания стала основой для теории морального статуса. Чуть позже круг таких объектов расширился (во многом благодаря активной разработке экологических проблем) — в него предложили включить растения и вообще всё живое. Впрочем, это решение пока остается спорным — как и вопрос о моральном статусе искусственного интеллекта.

Конечно, сейчас еще рано говорить о том, что использовать ИИ исключительно как средство и обижать его — значит вести себя недостойно. Он не испытывает ни боли, ни наслаждения, не понимает своего предназначения и, более того, был создан как инструмент.

Но что, если робот начнет мыслить так же, как и мы, обретет сознание? Должен ли в таком случае искусственный интеллект получить равный нашему статус? Или это лишнее — хотя бы потому, что ИИ не может пережить смерть, как мы, и различий между нами по-прежнему больше, чем сходств? У современных мыслителей пока нет готовых ответов.Философиня Мэри Энн Уоррен полагает, что нам вообще рано задаваться подобными вопросами, ведь мы пока еще не знаем, какое именно сознание получит искусственный интеллект. Всё это — дело очень далекого будущего. Однако уже сейчас стоит задуматься о тех случаях, когда ИИ, по-прежнему ничего не чувствуя и не осознавая себя, начнет настолько хорошо имитировать человеческое поведение, что роботы станут частью нашего общества.

Всё это — дело очень далекого будущего. Однако уже сейчас стоит задуматься о тех случаях, когда ИИ, по-прежнему ничего не чувствуя и не осознавая себя, начнет настолько хорошо имитировать человеческое поведение, что роботы станут частью нашего общества.

Мы будем строить отношения с искусственным интеллектом и, возможно, даже забывать, что он всего лишь притворяется. Как быть в этом случае? Должны ли мы наказывать за жестокое обращение с роботом, который реагирует так же, как и мы, однако чувствует иначе (если вообще способен на подобное)?

И здесь мнения разделились. Адепты поведенческой теории считают, что должны — ведь мы точно так же никогда не знаем, что именно испытывает другой человек, поскольку видим и анализируем лишь его поведение. Другие философы, включая и Уоррен, полагают, что вряд ли такое вообще возможно: для того чтобы успешно имитировать когнитивные процессы, а также взаимодействовать с людьми, искусственный интеллект по-прежнему будет нуждаться в минимальной способности к эмпатии, а значит, должен научиться испытывать эмоции.

Нам нужно внимательнее изучить возможность программирования чувств и понять, будет ли что-то подобное вообще когда-либо достижимо. Это и пытаются выяснить современные философы, работающие на пересечении этики и технологий.

Современность подкидывает множество интересных вопросов — нам остается лишь подходить ко всему критически и не бояться переосмысливать старые определения. Возможно, через пару десятков лет разговоры о моральном статусе искусственного интеллекта будут казаться такими же чудовищными, как сейчас — гендерная дискриминация. Меняя мир, мы должны меняться сами, и подвергать всё сомнению — одна из лучших стратегий.

Философия станет ключом к искусственному интеллекту | Дэвид Дойч

Утверждение, что человеческий мозг обладает способностями, которые в некоторых отношениях намного превосходят возможности всех других известных объектов в космосе, было бы бесспорным. Мозг — единственный объект, способный понять, что космос вообще существует, или почему существует бесконечное множество простых чисел, или что яблоки падают из-за искривления пространства-времени, или что повиновение своим врожденным инстинктам может быть морально оправдано. неверно, или что оно само существует. Его уникальные способности не ограничиваются такими церебральными вопросами. Холодный, физический факт заключается в том, что это единственный тип объекта, который может перемещаться в космос и обратно без вреда для себя, или предсказывать и предотвращать падение метеорита на себя, или охлаждать объекты до миллиардной доли градуса выше абсолютного нуля, или обнаруживать другие в своем роде на галактических расстояниях.

неверно, или что оно само существует. Его уникальные способности не ограничиваются такими церебральными вопросами. Холодный, физический факт заключается в том, что это единственный тип объекта, который может перемещаться в космос и обратно без вреда для себя, или предсказывать и предотвращать падение метеорита на себя, или охлаждать объекты до миллиардной доли градуса выше абсолютного нуля, или обнаруживать другие в своем роде на галактических расстояниях.

Но ни один мозг на Земле еще не близок к пониманию того, что делает мозг для достижения любой из этих функций. Предприятие по его искусственному достижению — область «искусственного общего интеллекта» или ОИИ — не продвинулась ни на йоту за все шесть десятилетий своего существования.

Несмотря на долгую историю неудач, ОИИ должен быть возможен. Это происходит из-за глубокого свойства законов физики, а именно универсальности вычислений. Из этого следует, что все, что законы физики требуют от физических объектов, в принципе может быть смоделировано в сколь угодно мельчайших деталях некоторой программой на компьютере общего назначения, при условии, что ей предоставлено достаточно времени и памяти.

Так почему поле не прогрессировало? На мой взгляд, это потому, что, как однажды заметил неизвестный мудрец, «не то, чего мы не знаем, вызывает проблемы, а то, что мы знаем, что это не так». Я не могу представить себе какой-либо другой значительной области знаний, в которой господствующая мудрость не только в обществе в целом, но и среди экспертов была бы настолько усеяна укоренившимися, частично совпадающими, фундаментальными ошибками. Тем не менее, это также была одна из самых самоуверенных областей в пророчестве о том, что она скоро достигнет окончательного прорыва.

В 1950 году Алан Тьюринг ожидал, что к 2000 году «можно будет говорить о машинном мышлении, не ожидая возражений». В 1968 году Артур Кларк ожидал, что это произойдет к 2001 году. Однако сегодня, в 2012 году, никто не умеет программировать ОИИ лучше, чем сам Тьюринг.

Это не удивляет уменьшающуюся группу противников самой возможности ОИИ. Но другой лагерь (приближающийся к ОИИ) признает, что эта история неудач нуждается в объяснении или, по крайней мере, в рационализации.

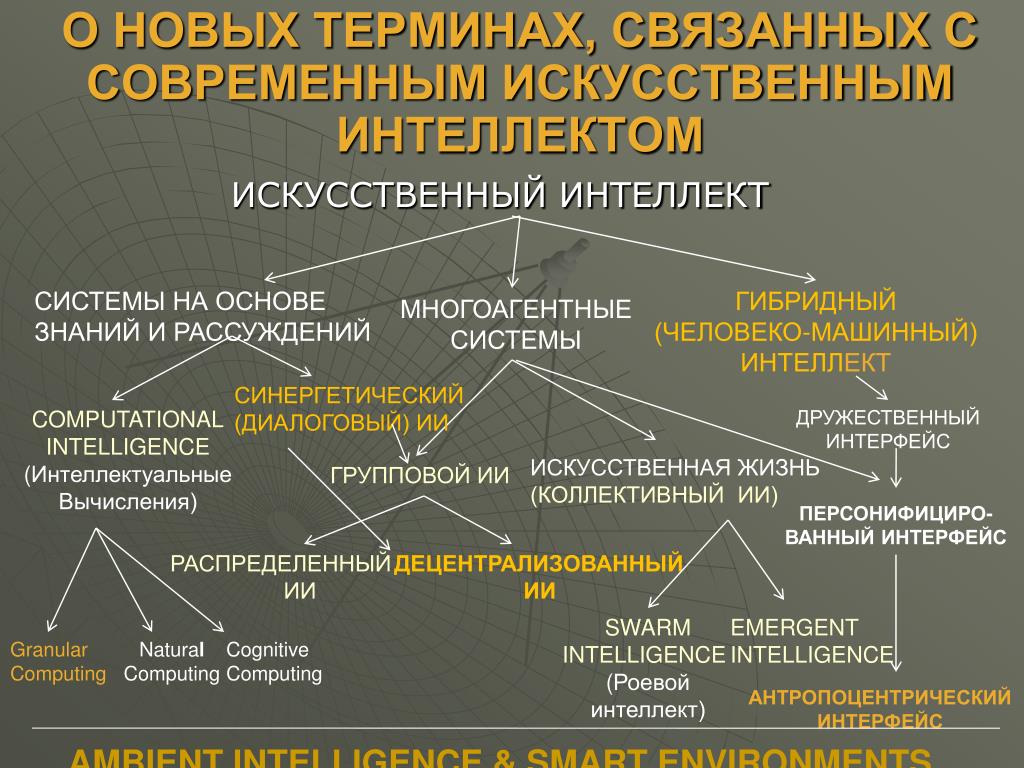

Сам термин «AGI» является примером одной из таких рационализаций, ибо область раньше называлась «AI» — искусственный интеллект. Но ИИ постепенно стал использоваться для описания всех видов несвязанных друг с другом компьютерных программ, таких как игровые плееры, поисковые системы и чат-боты, пока не была добавлена буква G для «общего», чтобы можно было снова ссылаться на реальную вещь, но теперь с подразумеванием, что AGI — это просто более умный вид чат-бота.

Другой класс рационализации работает в общих чертах: ОИИ все равно не так уж хорош; существующее программное обеспечение уже столь же умно или умнее, но не по-человечески, и мы слишком тщеславны или слишком культурно предвзяты, чтобы отдать ему должное. Это набирает обороты, потому что ссылается на устойчиво популярную иррациональность культурного релятивизма, а также на родственный троп: «Мы, люди, гордимся тем, что являемся образцом животных, но эта гордость неуместна, потому что у них тоже есть язык, инструменты… -осведомленность. » Помните значение, придаваемое компьютерной системе в фильмах «Терминатор», «Скайнет», обретение «самосознания»?

» Помните значение, придаваемое компьютерной системе в фильмах «Терминатор», «Скайнет», обретение «самосознания»?

Это еще одно философское заблуждение, которого достаточно, чтобы заблокировать любой жизнеспособный подход к ОИИ. Дело в том, что современные разработчики программного обеспечения могут прямо запрограммировать компьютер, чтобы он обладал «самосознанием» в поведенческом смысле — например, чтобы пройти «зеркальный тест» на способность использовать зеркало для вывода фактов о себе — если они хотели. Насколько мне известно, никто этого не сделал, предположительно потому, что это довольно бесполезная способность, а также тривиальная.

Возможно, причина, по которой самоосознание имеет незаслуженную репутацию связи с ОИИ, заключается в том, что благодаря теореме Гёделя и различным противоречиям в формальной логике в 20-м веке самореференция любого рода приобрела репутацию загадочной загадки. Так же и с сознанием. А для сознания мы снова имеем проблему неоднозначной терминологии: термин имеет огромный диапазон значений. На одном конце шкалы находится философская проблема природы субъективных ощущений («квалиа»), тесно связанная с проблемой ОИИ; но, с другой стороны, «сознание» — это просто то, что мы теряем, когда подвергаемся общей анестезии. Конечно, у многих животных это есть.

На одном конце шкалы находится философская проблема природы субъективных ощущений («квалиа»), тесно связанная с проблемой ОИИ; но, с другой стороны, «сознание» — это просто то, что мы теряем, когда подвергаемся общей анестезии. Конечно, у многих животных это есть.

ОИИ действительно будут способны к самосознанию — но это потому, что они будут Общими: они будут способны осознавать все виды глубоких и тонких вещей, включая самих себя. Это не означает, что обезьяны, прошедшие зеркальный тест, имеют хоть какой-то намек на атрибуты «общего интеллекта», искусственной версией которого был бы ОИИ. Действительно, замечательное исследование мемов горилл, проведенное Ричардом Бирном, показало, как обезьяны могут учиться полезному поведению друг у друга, даже не понимая, для чего они нужны: объяснение того, как работает познание обезьян, на самом деле является бихевиористским.

По иронии судьбы, эта группа рационализаций (ОИИ уже был сделан/это тривиально/существует у обезьян/является культурным тщеславием) является зеркальным отражением аргументов, возникших в лагере сторонников ОИИ-невозможно. Для каждого аргумента в форме «вы не можете создать ОИИ, потому что вы никогда не сможете запрограммировать человеческую душу, потому что это сверхъестественно», сторонники ОИИ-это просто имеют рационализацию: «если вы думаете, что человеческое познание качественно отличными от обезьян, вы должны верить в сверхъестественную душу».

Для каждого аргумента в форме «вы не можете создать ОИИ, потому что вы никогда не сможете запрограммировать человеческую душу, потому что это сверхъестественно», сторонники ОИИ-это просто имеют рационализацию: «если вы думаете, что человеческое познание качественно отличными от обезьян, вы должны верить в сверхъестественную душу».

«Все, что мы еще не умеем программировать, называется «человеческим интеллектом»» — еще одна такая рационализация. Это зеркальное отражение аргумента, выдвинутого философом Джоном Серлом (из лагеря «невозможных»), который указал, что до появления компьютеров паровые машины и более поздние телеграфные системы использовались как метафоры того, как должен работать человеческий разум. Он утверждает, что надежда на то, что ОИИ возможен, основывается на такой же иллюзорной метафоре, а именно на том, что разум является «по сути» компьютерной программой. Но это не метафора: универсальность вычислений следует из известных законов физики.

Некоторые предполагают, что мозг использует квантовые вычисления или даже гиперквантовые вычисления, основанные на пока еще неизвестной физике, помимо квантовой теории, и что это объясняет неудачу создания ОИИ на существующих компьютерах. Объяснение того, почему я и большинство исследователей квантовой теории вычислений не согласны с тем, что это вероятный источник уникальной функциональности человеческого мозга, выходит за рамки этой статьи.

Объяснение того, почему я и большинство исследователей квантовой теории вычислений не согласны с тем, что это вероятный источник уникальной функциональности человеческого мозга, выходит за рамки этой статьи.

То, что ОИИ — это «люди», с самого начала подразумевалось в самой концепции. Если бы существовала программа, в которой отсутствовала бы хотя бы одна когнитивная способность, характерная для людей, то она по определению не квалифицировалась бы как ОИИ; использование некогнитивных атрибутов (таких как процентное содержание углерода) для определения личности было бы расизмом, отдавая предпочтение органическому мозгу, а не кремниевому. Но тот факт, что способность создавать новые объяснения является уникальной, морально и интеллектуально значимой функциональностью «людей» (людей и ОИИ), и что они достигают этой функциональности путем догадок и критики, меняет все.

В настоящее время личность часто рассматривается скорее символически, чем фактически — как почетное обращение, обещание притвориться, что сущность (обезьяна, зародыш, корпорация) является личностью для достижения какой-либо философской или практической цели. Это нехорошо. Не обращайте внимания на терминологию; измените его, если хотите, и действительно есть причины относиться к различным сущностям с уважением, защищать их от вреда и так далее. Тем не менее, различие между реальными людьми, определяемыми этим объективным критерием, и другими сущностями имеет огромное моральное и практическое значение и станет жизненно важным для функционирования цивилизации, включающей ОИИ.

Это нехорошо. Не обращайте внимания на терминологию; измените его, если хотите, и действительно есть причины относиться к различным сущностям с уважением, защищать их от вреда и так далее. Тем не менее, различие между реальными людьми, определяемыми этим объективным критерием, и другими сущностями имеет огромное моральное и практическое значение и станет жизненно важным для функционирования цивилизации, включающей ОИИ.

Например, сам факт того, что человеком является не компьютер, а работающая программа, поднимает нерешенные философские проблемы, которые станут практическими, политическими спорами, как только появятся ОИИ, потому что, как только программа ОИИ запускается на компьютере, лишение его этого компьютера было бы убийством (или, по крайней мере, ложным тюремным заключением или обращением в рабство, в зависимости от обстоятельств), точно так же, как лишение человеческого разума его тела. Но в отличие от человеческого тела, программу ОИИ можно скопировать на несколько компьютеров одним нажатием кнопки. Являются ли эти программы, пока они все еще выполняют идентичные шаги (т. е. до того, как они стали дифференцированными из-за случайного выбора или различного опыта), одним и тем же человеком или множеством разных людей? Они получают один голос или много? Является ли удаление одного из них убийством или мелким нападением? А если какой-то мошенник-программист, возможно, нелегально, создаст миллиарды разных людей AGI, либо на одном компьютере, либо на многих, что произойдет дальше? Они все еще люди, с правами. Все ли они получают право голоса?

Являются ли эти программы, пока они все еще выполняют идентичные шаги (т. е. до того, как они стали дифференцированными из-за случайного выбора или различного опыта), одним и тем же человеком или множеством разных людей? Они получают один голос или много? Является ли удаление одного из них убийством или мелким нападением? А если какой-то мошенник-программист, возможно, нелегально, создаст миллиарды разных людей AGI, либо на одном компьютере, либо на многих, что произойдет дальше? Они все еще люди, с правами. Все ли они получают право голоса?

Кроме того, в отношении ОИИ, как и любых других сущностей с творческим потенциалом, мы должны забыть почти все существующие коннотации слова «программирование». Отношение к ОИИ как к любым другим компьютерным программам означало бы промывание мозгов, рабство и тиранию. И жестокость по отношению к детям тоже, потому что «программирование» уже работающего ОИИ, в отличие от любого другого программирования, представляет собой образование. И это представляет собой дебаты, как моральные, так и фактические. Игнорирование прав и индивидуальности ОИИ было бы не только воплощением зла, но и рецептом катастрофы: творческие существа не могут быть порабощены вечно.

Игнорирование прав и индивидуальности ОИИ было бы не только воплощением зла, но и рецептом катастрофы: творческие существа не могут быть порабощены вечно.

Некоторые люди задаются вопросом, должны ли мы приветствовать наших новых повелителей роботов и/или как мы можем изменить их программу, чтобы сделать их конституционно неспособными причинять вред людям (как в «трех законах робототехники» Азимова) и/или предотвратить их приобретение теория о том, что Вселенная должна быть превращена в скрепки. Это не проблема. Всегда было так, что один исключительно творческий человек может быть в тысячи раз более продуктивным, экономически, интеллектуально или каким-то еще, чем большинство людей; и что такой человек, обращая свои силы на зло вместо добра, может причинить огромный вред.

Эти явления не имеют ничего общего с ОИИ. Битва между идеями добра и зла стара, как наш вид, и будет продолжаться независимо от того, на каком оборудовании она работает. Вопрос в следующем: мы хотим, чтобы разум с (морально) хорошими идеями всегда побеждал злой разум, биологический и искусственный; но мы подвержены ошибкам, и наша собственная концепция «хорошего» нуждается в постоянном совершенствовании. Как должно быть организовано общество, чтобы способствовать этому улучшению? «Поработить весь разум» было бы катастрофически неверным ответом, а «поработить весь разум, который не похож на нас» — не намного лучше.

Как должно быть организовано общество, чтобы способствовать этому улучшению? «Поработить весь разум» было бы катастрофически неверным ответом, а «поработить весь разум, который не похож на нас» — не намного лучше.

Один из выводов заключается в том, что мы должны перестать рассматривать образование (как людей, так и ОИИ) как инструкцию — как средство передачи существующих знаний в неизменном виде и обеспечения послушного исполнения существующих ценностей. Как писал Карл Поппер (в контексте научных открытий, но это в равной степени применимо и к программированию ОИИ, и к обучению детей): «Нет такой вещи, как инструкции извне… Мы не открываем новые факты или новые эффекты, копируя их, или путем индуктивного вывода из наблюдения, или с помощью любого другого метода обучения со стороны окружающей среды. Мы используем, скорее, метод проб и устранения ошибок». Так сказать, домыслы и критика. Обучение должно быть чем-то, что только что созданный интеллект делает и контролирует сам.

Я не освещаю все эти философские вопросы, потому что боюсь, что ОИИ будут изобретены до того, как мы разовьем философскую изощренность, чтобы понять их и интегрировать в цивилизацию. Почти по противоположной причине: я убежден, что вся проблема разработки ОИИ является вопросом философии, а не информатики или нейрофизиологии, и что философский прогресс, который будет необходим для их будущей интеграции, также является предпосылкой для их разработки. в первую очередь.

Почти по противоположной причине: я убежден, что вся проблема разработки ОИИ является вопросом философии, а не информатики или нейрофизиологии, и что философский прогресс, который будет необходим для их будущей интеграции, также является предпосылкой для их разработки. в первую очередь.

Отсутствие прогресса в ОИИ происходит из-за сильного нагромождения заблуждений. Без попперовской эпистемологии невозможно даже предположить, какая детальная функциональность должна быть достигнута, чтобы создать ОИИ. А эпистемология Поппера не так широко известна, не говоря уже о том, что она достаточно хорошо понята, чтобы ее можно было применять. Думать об ОИИ как о машине для преобразования переживаний, наград и наказаний в идеи (или, что еще хуже, просто в поведение) — все равно, что пытаться вылечить инфекционные болезни, уравновешивая телесные жидкости: бесполезно, потому что коренится в архаичном и крайне ошибочном мировоззрении.

Не понимая, что функциональность ОИИ качественно отличается от любой другой компьютерной программы, человек работает в совершенно другой области. Если кто-то работает над программами, чье «мышление» конституционно неспособно нарушать заранее определенные ограничения, он пытается спроектировать определяющий атрибут разумного существа, человека: а именно творчество.

Если кто-то работает над программами, чье «мышление» конституционно неспособно нарушать заранее определенные ограничения, он пытается спроектировать определяющий атрибут разумного существа, человека: а именно творчество.

Устранение замятия журнала само по себе не даст ответа. Тем не менее ответ, задуманный в этих терминах, не может быть таким трудным. Еще одним следствием понимания того, что целевые способности качественно различны, является то, что, поскольку они есть у людей, а не у обезьян, информация о том, как их достичь, должна быть закодирована в относительно небольшом количестве различий между ДНК человека и ДНК человека. шимпанзе. Так что в одном отношении я могу согласиться с лагерем сторонников ИИИ: вполне вероятно, что между нами и прорывом стоит всего одна идея. Но это должна быть одна из лучших идей.

Профессор Дэвид Дойч — физик из Оксфордского университета и пионер квантовых вычислений. Это сокращенная версия эссе, опубликованного в цифровом журнале Aeon

Философия искусственного интеллекта | Бисма Фаррух

Философия искусственного интеллекта — это раздел философии, который исследует значение технологий.

Ее часто считают одной из самых захватывающих областей изучения философии. Это быстрорастущая область, в которой каждый год появляются новые интересные концепции. Давайте взглянем на некоторые из этих теорий: сингулярность, первую теорему Гёделя о неполноте и теорию Поллока. Опубликовано в

Ее часто считают одной из самых захватывающих областей изучения философии. Это быстрорастущая область, в которой каждый год появляются новые интересные концепции. Давайте взглянем на некоторые из этих теорий: сингулярность, первую теорему Гёделя о неполноте и теорию Поллока. Опубликовано в·

Чтение: 4 мин.·

6 октября 2022 г. Photo by Yeshi Kangrang на UnsplashКонцепция технологической сингулярности — один из самых больших вопросов в философии искусственного интеллекта. Сторонники сингулярности утверждают, что мир, возможно, находится на пороге технологического сверхразума, и что люди сталкиваются с серьезным риском быть захваченными такой силой. Они считают, что нынешнее поколение должно предпринять обдуманные действия для того, чтобы такое развитие событий не привело к катастрофе.

Хотя существует вероятность того, что ИИ можно запрограммировать на соблюдение деонтологических правил, это не обязательно. Если бы ИИ были разработаны, чтобы следовать служебным функциям, они могли бы делать это даже без текстовых описаний.

Теорема Курта Гёделя о неполноте для искусственного интеллекта вызвала бурные споры в математическом сообществе. В нем говорится, что любая последовательная формальная система, которая может производить простую арифметику, неполна. Это потому, что должны быть некоторые истинные утверждения теории чисел, которые не являются теоремами системы. Эта теорема имеет несколько возражений.

Первая теорема Гёделя о неполноте для искусственного интеллекта — одна из самых противоречивых идей в области искусственного интеллекта. Это предполагает, что вычислительные теории разума ошибочны и что нет никакого способа создать искусственный общий интеллект. Эта теорема также подразумевает, что мы не можем объяснить психические процессы животных с помощью вычислительной теории.

В «Философии искусственного интеллекта» Патнэма 1960 года американский философ и ученый-компьютерщик предложил новую теорию, основанную на множественной реализуемости, концепции, которая предполагает, что одно и то же психическое состояние может существовать в разных физических состояниях. Патнэм считал, что эта новая точка зрения более правдоподобна, чем теория тождества, потому что ментальные типы не идентичны своим физическим аналогам. Более того, Патнэм утверждал, что эта модель совместима с идеей о том, что психические состояния коррелируют один ко многим с физическими.

Патнэм считал, что эта новая точка зрения более правдоподобна, чем теория тождества, потому что ментальные типы не идентичны своим физическим аналогам. Более того, Патнэм утверждал, что эта модель совместима с идеей о том, что психические состояния коррелируют один ко многим с физическими.

Философия искусственного интеллекта (AIMA) — это область философии, которая направлена на развитие понимания природы интеллектуальных агентов и их возможностей. Его главная цель — разработать интеллектуальных агентов, которые могут рассуждать и делать выводы из различных источников знаний. Это достигается за счет кодирования знаний. Процесс кодирования знаний позволяет агенту использовать свои собственные знания для решения проблем в мире.

Философия ИИ включает в себя множество техник, возникших в результате изучения философии. К ним относятся индуктивная логика, теория вероятностей и практические рассуждения. Многие философы проводят исследования ИИ как часть своих исследований.

Фото Кенни Элиасона на Unsplash Философия искусственного интеллекта Патнэма — это исследование взаимосвязи между человеческим разумом и физическим телом. В исследовании рассматривается, как человеческая мысль связана с языком, мозгом и физическим телом. Хилари Патнэм провела исследование в этой области и написала статью «Мозг в чане», в которой основное внимание уделяется проблемам, связанным с человеческим мозгом и его взаимодействием с физическим телом.

В исследовании рассматривается, как человеческая мысль связана с языком, мозгом и физическим телом. Хилари Патнэм провела исследование в этой области и написала статью «Мозг в чане», в которой основное внимание уделяется проблемам, связанным с человеческим мозгом и его взаимодействием с физическим телом.

Книга начинается с изучения логики. В первой части книги обсуждается логический ИИ. Эта ветвь ИИ восходит к силлогизму Аристотеля, который пытается ответить на такие вопросы, как «Во что рационально верить перед лицом определенных наблюдений и вероятностей?»

Философия искусственного интеллекта Серла в последние годы привлекла внимание как спорная тема. Он утверждал, что мы — «машины», а компьютеры — такие же, как машины. Его аргумент основан на предпосылке, что наш разум подобен компьютерным программам и что они могут существовать на любом подходящем компьютере, будь то кремний, серое вещество или коллекция пивных банок. Следовательно, сознание — это не что-то особенное, а просто состояние, которое достигается запуском правильной компьютерной программы.

также

также ;

;